Anthropic近日正式推出其最新大模型Claude Opus 4.7,宣称这是当前可广泛使用的最强版本。此次升级聚焦于复杂任务处理、高清视觉理解和长链路工作流稳定性,旨在让模型更贴近实际应用场景中的需求。

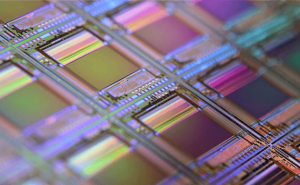

与前代4.6版本相比,Opus 4.7在视觉能力上实现质的飞跃。在特定基准测试中,其得分从约50%飙升至接近满分,补齐了AI在视觉理解领域的短板。这一突破使模型在处理密集截图、复杂图表等任务时表现更接近人类水平,甚至被认为可能跨越替代部分人类工作的关键门槛。

编程能力方面,新模型在修复GitHub多语言代码问题的测试中取得80.5%的准确率,较前代提升2.7个百分点。更引人注目的是其在长上下文任务中的表现:在模拟100万token图遍历的测试中,广度优先搜索准确率从41.2%跃升至58.6%,展现出处理复杂工作流的显著进步。自动售货机模拟经营测试显示,新模型在相同时间窗口内创造的收益较前代高出36%。

视觉定位能力是另一大亮点。在专业软件界面元素定位测试中,高分辨率场景下模型准确率达87.6%,较前代提升近20个百分点。这种"像素级"理解能力使其能精准解读VSCode、Photoshop等工具的界面指令,为自动化办公提供更强支撑。前端代码修复测试中,结合视觉素材的任务完成率提升7.4个百分点,印证了多模态处理能力的实质性突破。

在跨行业知识工作评估中,Opus 4.7以1753分的Elo评分领先GPT-5.4(1674分)和Gemini 3.1 Pro(1314分)。面对企业级文档分析挑战时,其80.6%的准确率较前代提升23.5个百分点,在生物分子推理等专项领域更实现2.4倍的性能跃升。这些数据表明,新模型在专业场景中的实用性已形成显著优势。

对于普通用户,最直观的改变体现在三个方面:指令遵循更严格,减少模糊理解;图像输入支持提升至375万像素,可处理更精细的视觉素材;输出结果更接近可直接使用的成品,在界面设计、文档整理等任务中展现更强创造力。早期测试反馈显示,复杂工作流的稳定性、错误恢复能力均有明显提升。

技术升级伴随成本变化。由于采用新分词器和更高分辨率支持,相同输入的token消耗可能增加1.35倍。虽然模型定价维持不变,但实际使用成本将随任务复杂度上升。Anthropic特别提醒用户优化图片输入,在不需要高精度视觉处理的场景中压缩图像以控制消耗。

安全架构同步升级成为另一焦点。作为Project Glasswing网络安全框架的首个落地模型,Opus 4.7内置高风险请求拦截机制,并推出合规研究人员验证计划。安全评估显示,其在诚实性和抗恶意提示注入方面表现更强,整体安全画像与前代持平但存在局部波动。

此次升级标志着大模型竞争进入新阶段。Anthropic通过强化长任务执行、多模态协同和自动化交付能力,试图重新定义生产力工具的标准。随着Xhigh Effort思考模式、Task Nudgets公测等配套功能上线,模型在复杂工作场景中的渗透速度可能进一步加快。