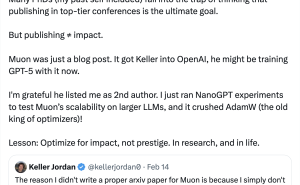

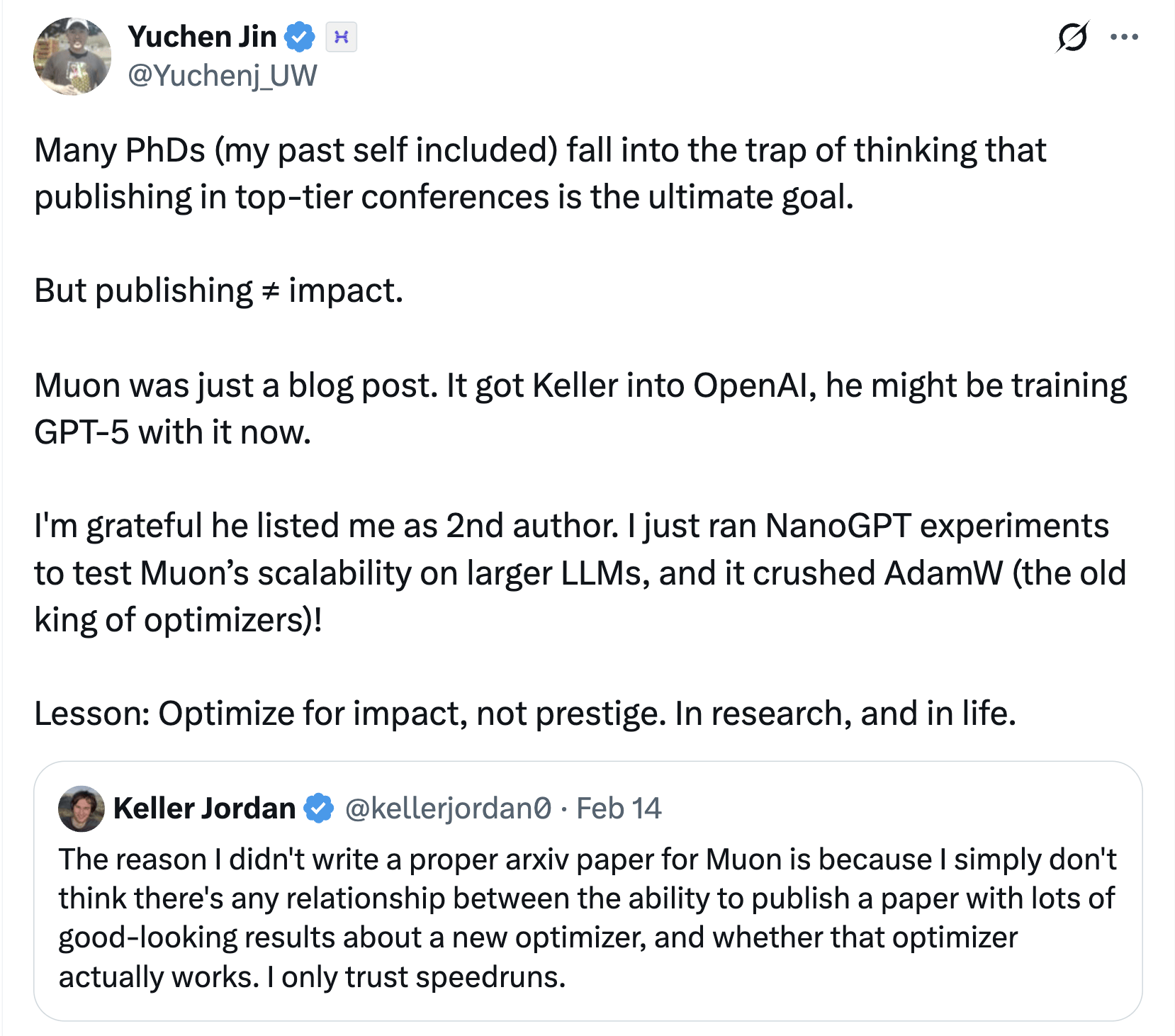

近日,AI界传出了一则令人瞩目的消息。据AI云服务商Hyperbolic的联合创始人兼CTO Yuchen Jin在社交平台上的爆料,研究员Keller Jordan仅凭一篇博客文章就成功加入了OpenAI,并且可能正在利用文章中提及的神经网络隐藏层优化器Muon来训练GPT-5。

Jin在爆料中感慨道,许多研究人员,包括曾经的自己,都曾误以为在顶级学术会议上发表论文才是最终目标。然而,发表论文并不等同于产生实际影响力。Keller Jordan发布的Muon优化器仅以博客形式问世,却帮助他叩开了OpenAI的大门,并有可能在GPT-5的训练中大放异彩。

Jordan的这篇博客发表于2024年12月,题为《Muon:神经网络隐藏层的优化器》。文章详细介绍了Muon的设计理念及其在多个实验中的优异表现。从职场社交平台领英的信息可以确认,Jordan正是在博客发布后不久加入了OpenAI,这无疑进一步证实了他的研究成果得到了业界的认可。

Muon作为一种针对神经网络隐藏层二维参数的优化器,在设计和应用上都有其独到之处。它通过采用SGD-momentum生成的更新,并在应用于参数之前对每个更新应用Newton-Schulz迭代作为后处理步骤,从而实现了更新矩阵的近似正交化。这一创新设计使得Muon在多个实验中都取得了显著优于传统优化器AdamW的表现。

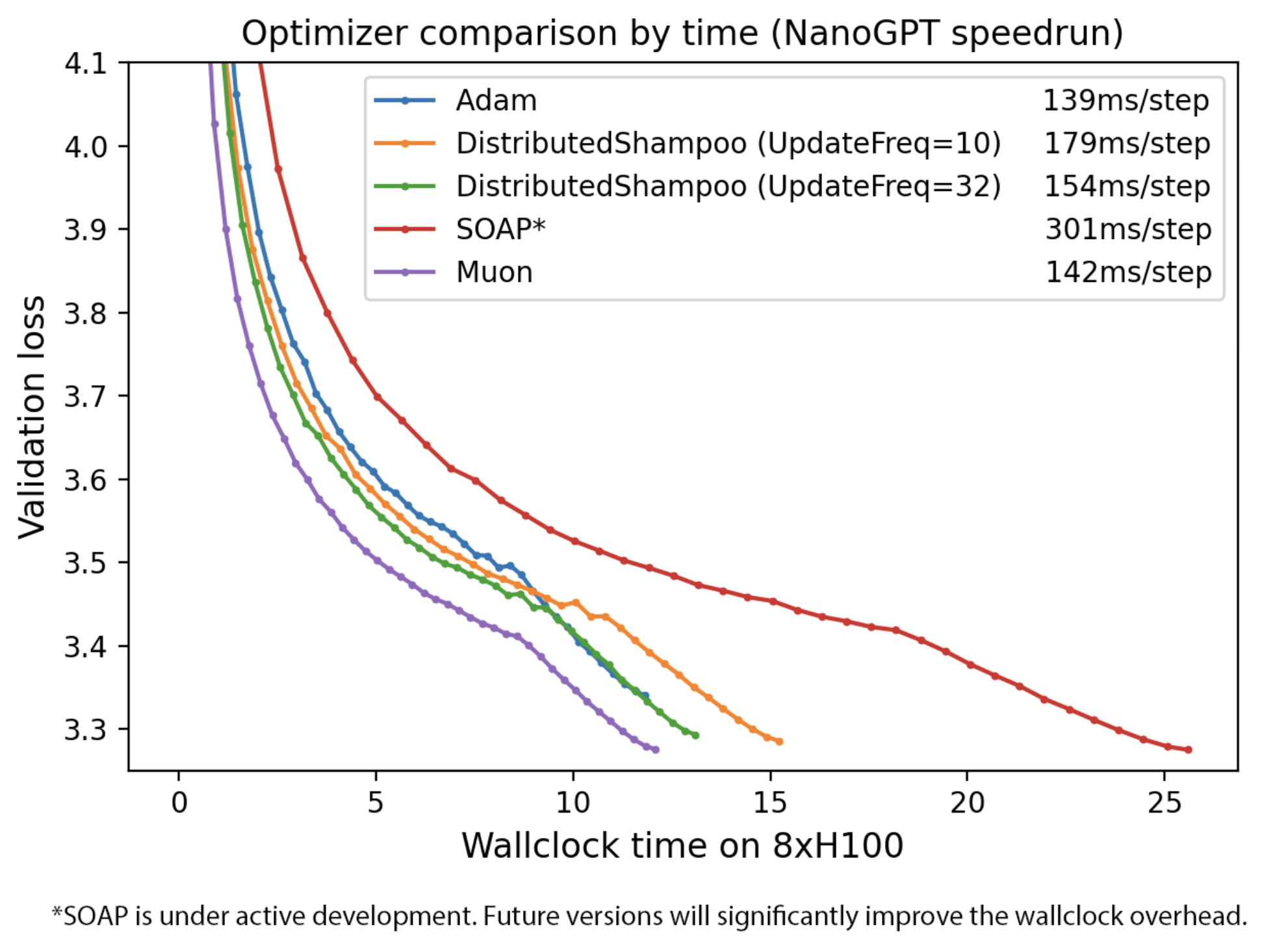

具体而言,Muon在CIFAR-10数据集上的训练速度记录从3.3秒提高到了2.6秒,准确率达到了94%;在FineWeb竞赛任务上的训练速度记录也提高了1.35倍。在扩展到更大规模的模型时,Muon仍然能够持续显示训练速度的提升。这些实证成果无疑为Muon在OpenAI中的应用提供了坚实的基础。

除了在设计上的创新,Jordan在博客中还对神经网络优化研究中的证据标准提出了犀利批评。他指出,当前的研究文献中充斥着大量声称能够击败AdamW的优化器,但这些优化器往往因为基线欠调而未能得到广泛采用。为了纠正这种情况,Jordan建议研究界应该要求新方法在竞争性训练任务中取得成功,以确保其有效性和可靠性。

随着Jordan加入OpenAI并可能参与GPT-5的训练工作,Muon这一全新优化器有望成为GPT-5中的重要技术。然而,关于Muon的未来发展仍有许多未知因素,包括其是否能够在更大规模的训练中扩展应用,以及在大型GPU集群中的正确分布等。或许在GPT-5的研究中,这些问题都将得到解答。